Vous vous intéressez à notre voisin anglais ; ses us et coutumes qui nous semblent parfois étranges ? Vous êtes curieux de la géographie de sa population, de sa démographie, de la pratique de la langue de Shakespeare ?

DataShine est un site de webmapping qu'il faut absolument visiter. L'objectif est de présenter au grand public les données locales du dernier recensement anglais (2011). Deux universitaires anglais ont relevé ce defi avec maestria. DataShine est une carte interactive avec une sémiologie très bien travaillée, facile d'accès et qui permet rapidement de visualiser les diversités locales de la société anglaise sous de multiples aspects : caractéristiques sociodémographiques, culturelles (origine ethnique, religions, langues), santé, logement, éducation, activité/emploi, flux et déplacements...

Allez donc faire un tour sur

DataShine en suivant ce lien. Le site et l'interface sont beaux, simples, pratiques et bien réfléchis. Sur une base d'informations importantes, les auteurs du site ont trouvé un juste compromis entre fluidité et richesses fonctionnelles. Les cartes détaillent des informations au niveau geographique fin des "census output area" (equivallent des iris de l'Insee).

Pour les professionels du "webMapping" souvent assimilés au mot valise "geek", j'attire l'attention sur deux fonctions novatrices, bien utiles et bluffantes:

1/ Integration dans l'analyse thématique d'un arrière fond du bâti

Par défaut l'analyse thématique de données censitaires couvre l'ensemble des zones bâties et non bâties. C'est une représentation biaisée et imprécise de la réalité. DataShine propose de montrer l'analyse thématique uniquement sur les polygones de description des bâtiments. Sur le complément des zones non bâties non habitées, il n'y a pas de raison de montrer l'analyse thématique.

Les vélomans : part des actifs se rendant au travail à vélo

version sans batis moche :

version avec couche des bâtiments, bien plus claire :

2/ Légende de l'analyse thématique automatiquement recalibrée sur la vue en cours

Par défaut la légende est calibrée automatiquement sur les données de l'ensemble de l'Angleterre. En fonction de la répartition de l'indicateur sélectionné, DataShine arbitre entre le calibrage en classes d'équi-amplitudes et le calibrage par la méthode de jenks (dite des "ruptures naturelles") basée sur la décomposition de la variance de l'indicateur (maximisation des variances interclasses et minimisation des variances intraclasses).

Pour les indicateurs avec une forte dispersion et une forte concentration sur certaines zones, la légende automatique n'est pas adaptée. DataShine propose une option "rescale on current view" qui recalcule automatiquement la légende sur les seuls quartiers de la vue écran.

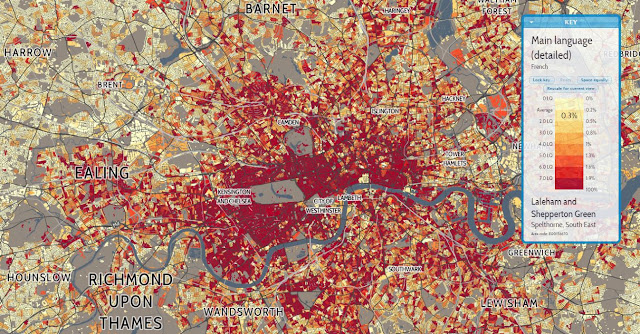

Prenons l'exemple du français parlé à Londres.

Français comme langue principale en % de la population

version avec une légende calibrée sur l'ensemble de l'Angleterre

Cette carte est peu informative. On sait bien que Londres est cosmopolite et accueille une population d'origine française importante par rapport au reste de l'Angleterre. Partout dans Londres, on peut demander l'heure à au moins une personne sur 100 dans la langue de Molière.

Français comme langue principale en % de la population

Version avec légende recalibrée sur la vue

C'est beaucoup plus clair maintenant : le quartier huppé de South Kensington est colonisé par des francophones. Une personne sur cinq peut vous indiquer votre chemin en français dans Fulham Road ou devant chez Harrods.

Bravo à James Chesshire et Oliver o'Brien pour ce travail "so inspiring". Merci à Paul Thompson pour m'avoir passé l'information.